概述

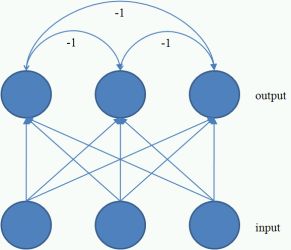

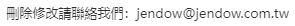

圖1.無監督式學習網路

圖1.無監督式學習網路無監督式學習網路(Unsupervised Learning Network)是人工智慧網路的一種算法(algorithm),其目的是對原始資料進行分類,以便了解資料內部結構。有別於監督式學習網路,無監督式學習網路在學習時並不知道其分類結果是否正確,亦即沒有受到監督式增強(告訴它何種學習是正確的)。其特點是僅對此種網路提供輸入範例,而它會自動從這些範例中找出其潛在類別規則。當學習完畢並經測試後,也可以將之套用到新的案例上。

監督式學習

監督式學習(英語:Supervised learning),是一個機器學習中的方法,可以由訓練資料中學到或建立一個模式(函式 / learning model),並依此模式推測新的實例。訓練資料是由輸入物件(通常是向量)和預期輸出所組成。函式的輸出可以是一個連續的值(稱為回歸分析),或是預測一個分類標籤(稱作分類)。

一個監督式學習者的任務在觀察完一些訓練範例(輸入和預期輸出)後,去預測這個函式對任何可能出現的輸入的值的輸出。要達到此目的,學習者必須以"合理"(見歸納偏向)的方式從現有的資料中一般化到非觀察到的情況。在人類和動物感知中,則通常被稱為概念學習(concept learning)。

非監督式學習

非監督式學習是一種機器學習的方式,並不需要人力來輸入標籤。它是監督式學習和強化學習等策略之外的一種選擇。在監督式學習中,典型的任務是分類和回歸分析,且需要使用到人工預先準備好的範例(base)。

一個常見的非監督式學習是數據聚類。在人工神經網路中,生成對抗網路(GAN)、自組織映射(SOM)和適應性共振理論(ART)則是最常用的非監督式學習。

ART模型允許叢集的個數可隨著問題的大小而變動,並讓使用者控制成員和同一個叢集之間的相似度分數,其方式為透過一個由使用者自定而被稱為警覺參數的常數。ART也用於模式識別,如自動目標辨識和數位信號處理。第一個版本為"ART1",是由卡本特和葛羅斯柏格所發展的。

算法

無監督式學習網路的算法一般僅涉及單一個核心模組,但重複多次計算而已。細節如下解釋:

無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路將輸入層各節點的激發程度表示為,輸出層各節點的激發程度表示為,從輸入層各節點指向輸出層各節點的網路路徑值表示為。輸出層各節點間則為互相抑制,亦即是一個對角線均為零,其餘元素為-1的矩陣。

核心模組的計算分為兩部分:

無監督式學習網路

無監督式學習網路 無監督式學習網路

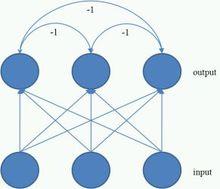

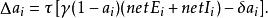

無監督式學習網路第一部分是想知道,當基於目前的情況下,若欲使網路穩定的話,則輸出層各節點激發程度 () 應該形成何種型態?計算乃遵循下列公式:

無監督式學習網路

無監督式學習網路步驟1:

無監督式學習網路

無監督式學習網路步驟2:

無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路重複此二步驟的的更新,直到低於某個臨界值(如:0.001)

無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路 無監督式學習網路

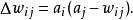

無監督式學習網路第二部分是想知道,若要得到剛才的激髮型態的話,則應該反映在的何種調整上,以便使得可以更直接透過來得到?

公式如下:

無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路 無監督式學習網路

無監督式學習網路最後整體計算便將所有的輸入資料分別透過上述的核心模組來得到,然後全部加總後,更新到實際的上頭,並重複所有步驟若干次(如:50次)即可。

常見的套用

1. 聚類分析 (clustering analysis)

2. 向度縮減 (dimensionality reduction)

特定的無監督式學習網路

1. 自我組織圖像網路(Self-Organizing Map, SOM): 目的是產生一種地形組織(topographic organization),地圖上相近的地點代表有相似屬性的輸入。

2.適應性共振理論網路(Adaptive Resonance Theory, ART; Carpenter & Grossberg, 1988)。

相關條目

•人工神經網路

•監督式學習

•監督式學習網路

•非監督式學習

•非監督式學習網路